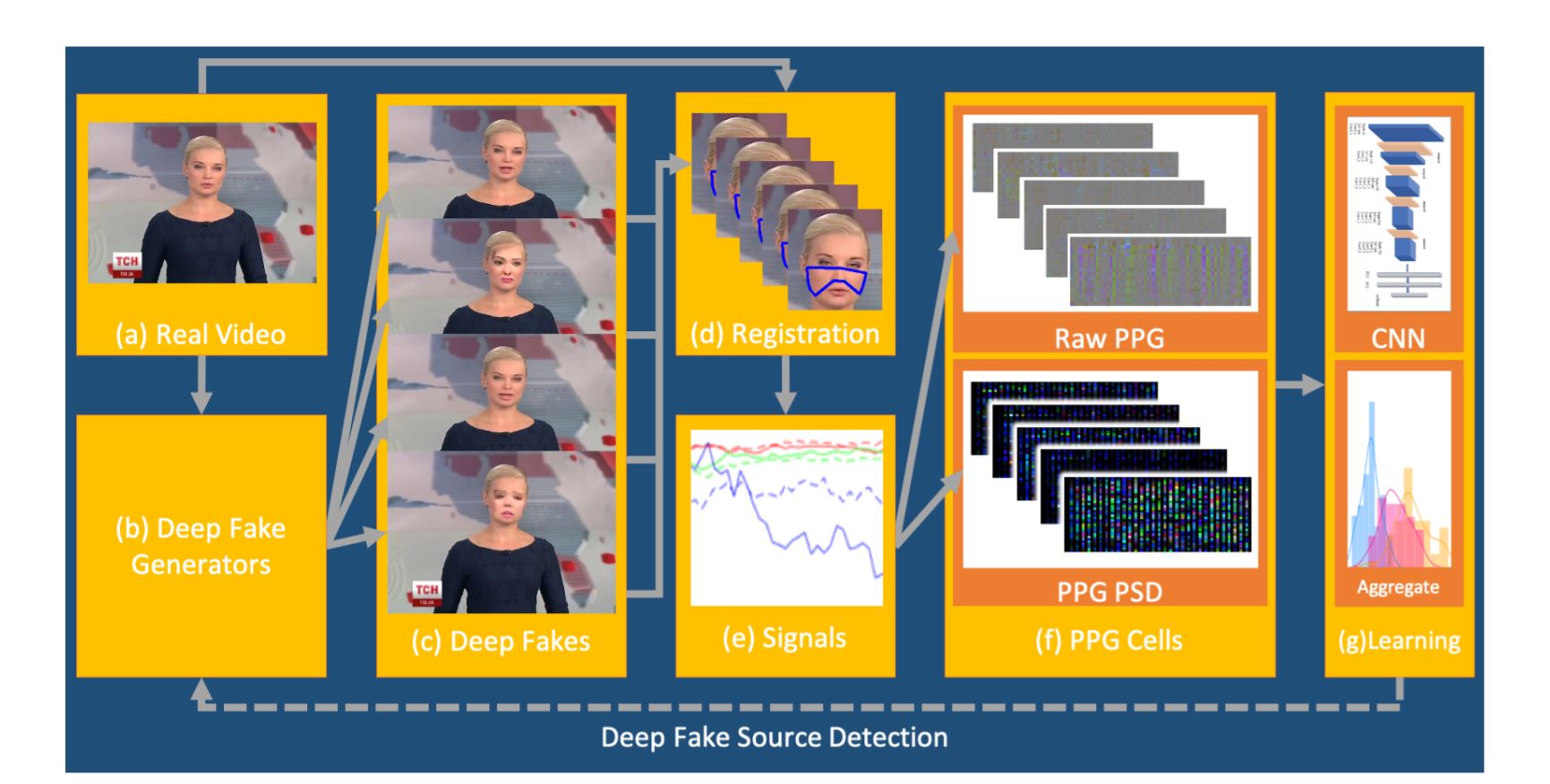

Процес визначення справжності відео. Umur Aybars Ciftci et al / arXiv.org

Дослідники штучного інтелекту використали датчики для реєстрації кров’яного потоку, щоб розпізнавати відео, створені за технологією Deepfake. Цей метод дозволяє не тільки ефективно ідентифікувати такі відео, але й визначати їхні генеративні моделі. Стаття про це доступна на сайті препринтів arXiv.org.

Що таке Deepfake?

Використання штучного інтелекту для створення синтетичних відео знизило необхідний рівень кваліфікації для реалістичної маніпуляції зображеннями. Так, технологія Deepfake дозволяє створювати синтетичні портретні відео реальних людей, достатньо фотореалістичні для того, щоб видавати їх за справжні. Хоча ця технологія створювалася з позитивним наміром щодо використання у фільмах, рекламі та розвагах, її застосовують для створення порнографії та фейків з метою політичної дезінформації. Існуючі моделі виявлення фейкових відео зосереджуються в основному на традиційних методах криміналістичної інформації, таких як відстеження неприродних рухів повік або спотворень на краю обличчя.

Який спосіб запропонували вчені?

Біологічні сигнали присутні у всіх людей. Такі анатомічні дії, як серцебиття, кровотік або дихання створюють тонкі зміни, які можна зафіксувати. Наприклад, коли кров рухається крізь вени, відбивна здатність шкіри з часом змінюється через вміст гемоглобіну в крові. Метод фотоплетизмографії здатний перевести такі візуальні сигнали у серцебиття людини, його застосовують у сфері охорони здоров’я. Вчені вирішили використати цей метод для боротьби з фейковими відео, адже наразі жодна генеративна модель не здатна зімітувати рух крові людини.

Завдяки цьому дослідники представили штучний інтелект, який виходить за рамки розпізнавання фальшивих відео та може визначати, яка модель їх генерує. Щоб це зробити, штучний інтелект шукає біологічні сигнали від 32 різних ділянок на обличчі людини. В експериментах із наборами відеофайлів deepfake цей підхід виявляв підробку з точністю 97,3% та визначав генеративні моделі відео з точністю 93,4%.

Поєднання такого методу з вже існуючими способами аутентифікації відео дозволить досягти ще більшої точності та надійності.